Computación

| ||||||||

Computación. Conjunto de conocimientos científicos y de técnicas que hacen posible el tratamiento automático de la información por medio de computadoras. La informática combina los aspectos teóricos y prácticos de la ingeniería, electrónica, teoría de la información, matemática, lógica y comportamiento humano. Los aspectos de la informática cubren desde la programación y la arquitectura informática hasta la inteligencia artificial y la robótica.

Sumario

Historia

Antes de disponer de palabras o símbolos para representar los números, el hombre primitivo empleaba sus dedos para contar. Con el tiempo se fueron desarrollando diferentes instrumentos que le permitirían agilizar sus capacidades de realizar cuentas.

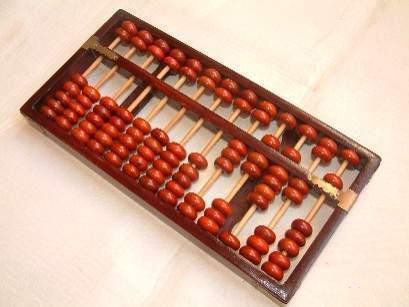

Los orígenes de las computadoras se remontan hasta las actividades del comercio antiguo. El término computar puede traducirse literalmente como contar. Los primeros elementos utilizados para agilizar las operaciones de cálculo fueron instrumentos manuales que permitían "llevar la cuenta" . Uno de los más conocidos es el ábaco.

El antepasado del ábaco consistía en unas piedras introducidas en la arena. Estas piedras móviles llevaron al desarrollo del ábaco, que ya se conocía, en el año 500 a.n.e. en Egipto. Gracias al ábaco, pudieron funcionar con cierta agilidad los negocios en el mundo antiguo y los comerciantes podían sumar, restar, multiplicar y dividir fácilmente.

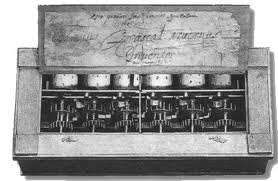

La primera máquina de calcular mecánica, un precursor del ordenador, fue inventada en 1642 por el matemático francés Blaise Pascal. Aquel dispositivo utilizaba una serie de ruedas de diez dientes en las que cada uno de los dientes representaban un dígito del 0 al 9. Las ruedas estaban conectadas de tal manera que podían sumarse números haciéndolas avanzar el número de dientes correcto. En 1670 el filósofo y matemático alemán Gottfried Wilhelm Leibniz perfeccionó esta máquina e inventó una que también pódía multiplicar.

El inventor francés Joseph Marie Jacquard, al diseñar un telar automático, utilizó delgadas placas de madera perforadas para controlar el tejido utilizado en los diseños complejos. Durante la década de 1880 el estadístico estadounidense Herman Hollerith concibió la idea de utilizar tarjetas perforadas, similares a las placas de Jacquard, para procesar datos. Hollerith consiguió compilar la información estadística destinada al censo de población de 1890 de Estados Unidos mediante la utilización de un sistema que hacía pasar tarjetas perforadas sobre contactos eléctricos.

Máquinas electromecánicas de Contabilidad (MEC)

Los resultados de las máquinas tabuladoras tenían que llevarse al corriente por medios manuales, hasta que en 1919 la Computing-Tabulating-Recording-Company. Anunció la aparición de la impresora/listadora. Esta innovación revolucionó la manera en que las compañías efectuaban sus operaciones. Para reflejar mejor el alcance de sus intereses comerciales, en 1924 la Compañía cambió el nombre por el de International Bussines Machines Corporation (IBM). Durante décadas, desde mediados de los cincuentas la tecnología de las tarjetas perforadas se perfeccionó con la implantación de más dispositivos con capacidades más complejas. Dado que cada tarjeta contenía en general un registro (un nombre, dirección, etc.) el procesamiento de la tarjeta perforada se conoció también como procesamiento de registro unitario.

Máquina analítica

También en el siglo XIX el matemático e inventor británico Charles Babbage elaboró los principios de la computadora digital moderna. Inventó una serie de máquinas, como la máquina diferencial, diseñadas para solucionar problemas matemáticos complejos. Muchos historiadores consideran a Babbage y a su socia, la matemática británica Ada Byron (1815-1852)]], hija del poeta inglés Lord Byron, como a los verdaderos inventores de la computadora digital moderna.

La tecnología de aquella época no era capaz de trasladar a la práctica sus acertados conceptos; pero una de sus invenciones, la máquina analítica, ya tenía muchas de las características de un ordenador moderno. Incluía una corriente, o flujo de entrada en forma de paquete de tarjetas perforadas, una memoria para guardar los datos, un procesador para las operaciones matemáticas y una impresora para hacer permanente el registro.

Primeros ordenadores

Los ordenadores analógicos comenzaron a construirse a principios del siglo XX. Los primeros modelos realizaban los cálculos mediante ejes y engranajes giratorios. Con estas máquinas se evaluaban las aproximaciones numéricas de ecuaciones demasiado difíciles como para poder ser resueltas mediante otros métodos. Durante las dos guerras mundiales se utilizaron sistemas informáticos analógicos, primero mecánicos y más tarde eléctricos, para predecir la trayectoria de los torpedos en los submarinos y para el manejo a distancia de las bombas en la aviación.

Ordenadores electrónicos

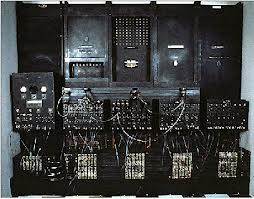

Durante la Segunda Guerra Mundial (1939-1945), un equipo de científicos y matemáticos que trabajaban en Bletchley Park, al norte de Londres, crearon lo que se consideró el primer ordenador digital totalmente electrónico, el Colossus. Hacia diciembre de 1943 el Colossus, que incorporaba 1.500 válvulas o tubos de vacío, era ya operativo. Fue utilizado por el equipo dirigido por Alan Turing para descodificar los mensajes de radio cifrados de los alemanes. Este prototipo y las investigaciones posteriores se realizaron en el anonimato, y más tarde quedaron eclipsadas por el desarrollo del calculador e integrador numérico digital electrónico ENIAC en 1945.

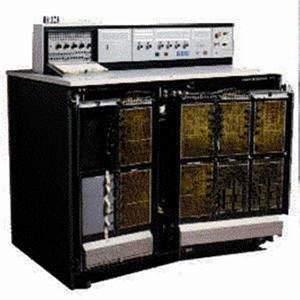

El ENIAC, que según mostró la evidencia se basaba en gran medida en el ordenador Atanasoff-Berry (ABC, acrónimo de Electronic Numerical Integrator and Computer), obtuvo una patente que caducó en 1973, varias décadas más tarde. Contenía 18.000 válvulas de vacío y tenía una velocidad de varios cientos de multiplicaciones por minuto, pero su programa estaba conectado al procesador y debía ser modificado manualmente. Se construyó un sucesor del ENIAC con un almacenamiento de programa que estaba basado en los conceptos del matemático húngaro-estadounidense John von Neumann. Las instrucciones se almacenaban dentro de una llamada memoria, lo que liberaba al ordenador de las limitaciones de velocidad del lector de cinta de papel durante la ejecución y permitía resolver problemas sin necesidad de volver a conectarse al ordenador.

A finales de la década de 1950 el uso del transistor en los ordenadores marcó el advenimiento de elementos lógicos más pequeños, rápidos y versátiles de lo que permitían las máquinas con válvulas. Como los transistores utilizan mucha menos energía y tienen una vida útil más prolongada, a su desarrollo se debió el nacimiento de máquinas más perfeccionadas, que fueron llamadas ordenadores o computadoras de segunda generación. Los componentes se hicieron más pequeños, así como los espacios entre ellos, por lo que la fabricación del sistema resultaba más barata.

Circuitos integrados

A finales de la década de 1960 apareció el circuito integrado (CI), que posibilitó la fabricación de varios transistores en un único sustrato de silicio en el que los cables de interconexión iban soldados. El circuito integrado permitió una posterior reducción del precio, el tamaño y los porcentajes de error. El microprocesador se convirtió en una realidad a mediados de la década de 1970, con la introducción del circuito de integración a gran escala (LSI, acrónimo de Large Scale Integrated) y, más tarde, con el circuito de integración a mayor escala (VLSI, acrónimo de Very Large Scale Integrated), con varios miles de transistores interconectados soldados sobre un único sustrato de silicio.

Microminiaturización

Una tendencia constante en el desarrollo de los ordenadores es la microminiaturización, iniciativa que tiene a comprimir más elementos de circuitos en un espacio de chip cada vez más pequeño. Además, los investigadores intentan agilizar el funcionamiento de los circuitos mediante el uso de la superconductividad, un fenómeno de disminución de la resistencia eléctrica que se observa cuando se enfrían los objetos a temperaturas muy bajas.

Las redes informáticas se han vuelto cada vez más importantes en el desarrollo de la tecnología de computadoras. Las redes son grupos de computadoras interconectados mediante sistemas de comunicación. La red pública Internet es un ejemplo de red informática planetaria. Las redes permiten que las computadoras conectadas intercambien rápidamente información y, en algunos casos, compartan una carga de trabajo, con lo que muchas computadoras pueden cooperar en la realización de una tarea. Se están desarrollando nuevas tecnologías de equipo físico y soporte lógico que acelerarán los dos procesos mencionados.

Otra tendencia en el desarrollo de computadoras es el esfuerzo para crear computadoras de quinta generación, capaces de resolver problemas complejos en formas que pudieran llegar a considerarse creativas. Una vía que se está explorando activamente es el ordenador de proceso paralelo, que emplea muchos chips para realizar varias tareas diferentes al mismo tiempo. El proceso paralelo podría llegar a reproducir hasta cierto punto las complejas funciones de realimentación, aproximación y evaluación que caracterizan al pensamiento humano.

Otra forma de proceso paralelo que se está investigando es el uso de computadoras moleculares. En estas computadoras, los símbolos lógicos se expresan por unidades químicas de ADN en vez de por el flujo de electrones habitual en las computadoras corrientes. Las computadoras moleculares podrían llegar a resolver problemas complicados mucho más rápidamente que las actuales supercomputadoras y consumir mucha menos energía.

Desarrollo de computadoras

Pueden identificarse dos (02) tendencias dentro del desarrollo de computadoras, en primer lugar una tendencia dentro del desarrollo de los programas y lenguajes usados en la operación de las computadoras y la otra dentro de equipos y computadoras.

En primer lugar los programas y lenguajes están evolucionando hacia autonomía propia que les permita realizar más y más tareas sin ayuda del humano, además de copiar la forma de razonar propia de sus creadores. Dentro de esta idea podemos citar las filosofías de "Inteligencia Artificial" y "Sistema Expertos".

El concepto de Inteligencia Artificial se refiere a la idea de que un programa o lenguaje sea capaz de "aprender" y de razonar, tal y como lo haría un humano. Un programa de inteligencia artificial es capaz de aprender de sus propios errores corrigiendo su operación en función de sus propios resultados almacenando de alguna forma esta experiencia adquirida para situaciones futuras.

Las tendencias de los programas y lenguajes es independizarse de sus creadores dejando de ser ya una simple herramienta tener más bien la cualidad de un colaborador dentro del trabajo a desempeñar.

Los equipos de computación modernos incluyen nuevas y mejores capacidades de generación de sonido, imagen y otros usados en las presentaciones, producción de prensa, cine y televisión "por computadora", que es lo que se ha dado por llamar la revolución de los medios múltiples. Por otro lado el desarrollo futuro de los equipos de computación debe seguir en alguna medida el desarrollo de los programas que los alimentan, buscando una mayor autonomía por parte del equipo en sí.

Cobran interés en esta área los términos Robótica y Cibernética, que identifican a las ramas de la ciencia que se encargan de producir elementos con movilidad propia y que imitan los movimientos y funciones del cuerpo humano o de animales y seres naturales, brazos mecánicos, ojos electrónicos y otros elementos robóticas avanzados han de pasar a formar parte de los equipos de computación futuros.

Estos desarrollos nos acercarán a esas máquinas con autonomía propia que tan comúnmente nos presentan las obras de Ciencia Ficción, pero definitivamente esa a de ser la tendencia futura de la computadora ya robot o sistema robótica, totalmente autónomo y capaz de la realización de tareas sofisticadas sin intervención humana.

Véase también

Enlaces externos

- Historia de la Computacion

- Computación

- Computación

- Ciencias de la computación

- Que és la computación?

Fuentes

- Artículo Definición de computación. Disponible en: "definicion.de". Consultado:14 de enero de 2012.

- Artículo Qué es la computación?.Disponible en: "www.portalplanetasedna.com.ar". Consultado: 14 de enero de 2012.

- Artículo Primeros pasos de la computación y la computadora.Disponible en: "www.monografias.com". Consultado: 14 de enero de 2012.